Le 28 juillet 2023, Stability.AI, annonçait deux nouveaux Large Language Models, Stable Beluga 1 et Stable Beluga 2 (FreeWilly).

Ces deux modèles sont du type ChatGPT, c’est à dire post-entraînés pour du Chat (+ autre)

Stable Beluga 1 est créé à partir de Llama 65B, c’est à dire la version 1 de Llama ayant 65B paramètres, et Stable Beluga 2 est créé à partir de Llama 70B, c’est à dire la version 2 de Llama ayant 70B paramètres.

Lorsque Meta a annoncé Llama 2, ils ont aussi annoncé Llama 2 Chat :

Llama 2 was pretrained on publicly available online data sources. The fine-tuned model, Llama-2-chat, leverages publicly available instruction datasets and over 1 million human annotations.

https://ai.meta.com/resources/models-and-libraries/llama/

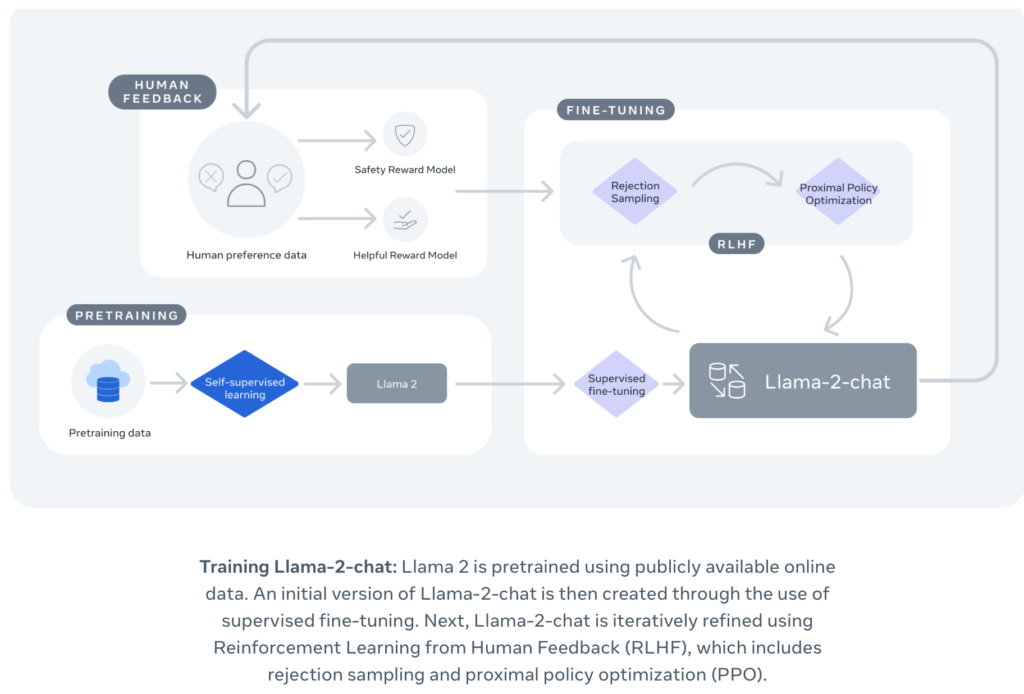

Llama 2 Chat a été entraîné par SFT et RLHF.

Llama 2-Chat is the result of several months of research and iterative applications of alignment techniques, including both instruction tuning and RLHF, requiring significant computational and annotation resources.

Llama-2-chat uses reinforcement learning from human feedback to ensure safety and helpfulness.

https://ai.meta.com/resources/models-and-libraries/llama/

Stability.ai a aussi utilisé la technique du SFT.

Stable Beluga 1 leverages the original LLaMA 65B foundation model and was carefully fine-tuned with a new synthetically-generated dataset using Supervised Fine-Tune (SFT) in standard Alpaca format. Similarly, Stable Beluga 2 leverages the LLaMA 2 70B foundation model to achieve industry-leading performance.

https://stability.ai/blog/stable-beluga-large-instruction-fine-tuned-models

Alors quelle est la différence entre les deux ?

Lorsqu’on étudie le benchmark général des LLM open source d’hugging Face, à la date du 1er août 2023, StableBeluga2 arrive en tête du leaderboard pour tous les benchmarks retenus (ARC, HellaSwag, MMLU, TruthfulQA). Il n’y a pas par contre de Llama 2 Chat.

J’essaierai de répondre plus tard à cette question lorsque j’aurai compris l’absence de Llama 2 Chat.

De façon étonnante, Beluga n’est pas proposé avec une licence aussi ouverte que Llama 2.

Both models are research experiments and are released to foster open research under a non-commercial license.

https://stability.ai/blog/stable-beluga-large-instruction-fine-tuned-models

Je reviendrai dans un prochain article sur la description technique de Beluga.